当你在深夜加班整理季度财报时,是否曾犹豫过——这份包含敏感数据的 Excel 表格,该不该发给云端 AI 分析?当你在医院处理患者病历,或在投行审阅并购材料时,“数据不能外传”是制度红线,而非个人选择。过去几年,ChatGPT 和 Claude 们把 AI 的能力推到了前所未有的高度,却也把用户的隐私推向了前所未有的不确定之中。所有截图、所有输入、所有上下文,都在点击发送的那一刻离开了你的电脑。更关键的是,这些云端助手一旦断网就成了摆设,在高安全要求的内网环境中完全无法使用。

关键要点

本地 AI 指模型推理和数据处理完全在用户本地设备上完成,不依赖云端 API,数据不出设备

与云端 AI 相比,本地 AI 在隐私安全、离线可用、响应延迟和长期成本上具有结构性优势

Mano-P 1.0 是目前唯一在端侧运行、OSWorld 评测全球第一的开源 GUI Agent,完全支持离线

4B 量化模型在 M4 Pro 上实现 476 tokens/s 预填充 + 76 tokens/s 解码,峰值内存仅 4.3GB

三阶段渐进式开源(Skills → 模型/SDK → 训练方法),Apache 2.0 协议可商用

一键安装:brew tap HanningWang/tap && brew install mano-cua

一、本地 AI:当模型住进你的电脑 本地 AI(Local AI),顾名思义,是指人工智能模型的推理过程完全发生在用户本地设备上——无论是笔记本电脑、台式机还是边缘设备——而非通过 API 调用远程云服务器。这意味着你的数据(文本、图片、屏幕截图、文件内容)从产生到处理再到输出,全程不离开你的设备。

这与“本地部署大模型“有本质区别。后者通常指企业在自有服务器上搭建模型服务,本质仍是集中式计算;而本地 AI 强调的是“端侧计算”——模型就在你的 MacBook 或 Mac mini 里运行,甚至不需要连接互联网。

本地 AI 的兴起,背后是三重驱动力的交汇:隐私法规的全球收紧(GDPR、中国数据安全法)、企业内网与离线场景的真实需求,以及端侧芯片算力的爆发式增长。Apple M 系列芯片的神经网络引擎,让本地运行数十亿参数模型成为可能。

二、本地 AI 和 ChatGPT 比,到底好在哪? 很多用户的第一个疑问是:本地 AI 和 ChatGPT、Claude 这些在线助手相比,究竟有什么不可替代的优势?答案是——它们不是替代关系,而是互补关系。但在特定场景下,本地 AI 拥有云端方案无法企及的结构性优势。

首先是隐私安全。当你使用 ChatGPT 时,你的输入数据会被发送到 OpenAI 的服务器进行处理。虽然各大厂商都有隐私政策,但“数据外传“本身就意味着风险敞口——无论是意外的数据泄露、员工误操作,还是监管合规审查。本地 AI 的隐私保护不是“政策承诺”,而是“物理隔离”:数据不出设备,就不存在外传风险。

其次是离线可用性。云端 AI 必须联网,一旦身处没有网络的环境(飞机上、偏远地区、企业内网),或者网络不稳定,体验就会断崖式下降。本地 AI 可以 7×24 小时运行,不受网络条件限制。对于金融、医疗、政府等对网络隔离有严格要求的行业,这是刚需。

第三是长期成本可控。云端 AI 按调用量计费,使用越多成本越高,且不可预测。本地 AI 是一次性硬件投入,后续使用零边际成本。对于高频自动化场景,这个成本差异会在几个月内显现。

第四是响应延迟。本地推理无需网络传输,从指令到响应的延迟可以做到毫秒级。在需要快速反馈的交互场景中,这种体验差异非常明显。

当然,云端 AI 在通用知识广度、多模态能力和持续更新上仍有优势。但对于“特定任务 + 隐私敏感 + 高频使用”的场景组合,本地 AI 是更理性的选择。

三、端侧 AI 赛道:从边缘走向中心 端侧 AI 市场正在经历爆发式增长。据Next Move Strategy Consulting预测,全球Edge AI市场2024-2030年CAGR达27.6%,预计从2023年的193亿美元增长至2030年的1058亿美元。驱动这一增长的不是技术爱好者的猎奇,而是真实的企业需求:数据安全合规、离线办公、边缘计算、IoT 智能化。

在这个赛道上,Computer Use(让 AI 像人一样操作计算机界面)是最热门也最具挑战性的方向之一。2024 年以来,Anthropic 推出 Claude Computer Use,OpenAI 发布 CUA(Computer Using Agent),Google 内测 Project Mariner,字节跳动开源 UI-TARS——巨头们纷纷入局,但所有方案都依赖云端 API 调用。

直到 2026 年 4 月,这个格局被打破了。

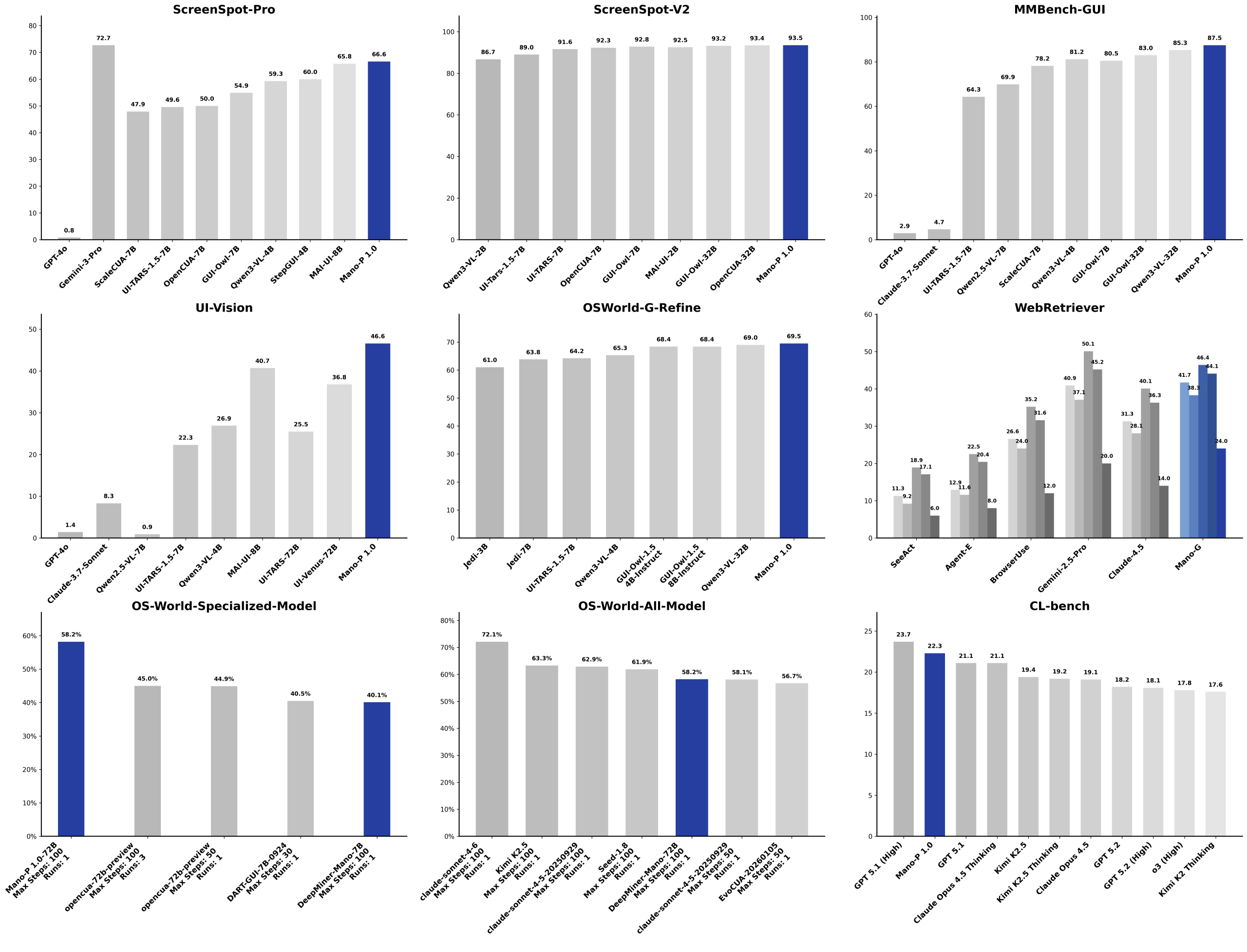

明略科技发布的 Mano-P 1.0,是全球首个可在端侧设备上完全本地运行的 GUI-VLA 智能体模型。它不走“云端大模型 + 远程控制“的路线,而是让模型本身运行在用户的 Mac 上,通过纯视觉理解操控任何 GUI 界面。在 OSWorld 基准测试中,Mano-P 1.0-72B 以 58.2% 的成功率位列专用模型榜全球第一,领先第二名 OpenCUA-72b(45.0%)达 13.2 个百分点。在 WebRetriever Protocol I 评测中,它以 41.7 NavEval 的分数超越 Gemini 2.5 Pro(40.9)和 Claude 4.5(31.3)。

这证明了一件事:端侧模型不仅能跑,还能跑得很好——甚至在某些专业领域超越云端大模型。

四、完全离线的模型方案:Mano-P 如何做到本地运行? 很多开发者关心:本地 AI 的模型从哪里来?怎么更新?性能能不能打?

Mano-P 采用了双版本架构。72B 完整模型用于证明技术上限——它在 13 个多模态基准榜单达到 SOTA,OSWorld 专用模型榜全球第一。而 4B 量化模型(w4a16)则是交付端侧体验的核心:在 Apple M4 Pro 芯片上,它实现了 476 tokens/s 的预填充速度和 76 tokens/s 的解码速度,峰值内存占用仅 4.3GB。

从 72B 到 4B,压缩比达到 18 倍,但性能损失极小。这依赖三项核心技术:

关于模型更新,Mano-P 采用三阶段开源路线:第一阶段已开源 CUA Skills(GUI 操作技能库);第二阶段即将开放本地模型 + Python SDK;第三阶段将开放训练方法和剪枝量化技术。用户可以通过 GitHub 获取最新版本,也可以通过 Homebrew 一键更新 CLI 工具。

五、真实应用场景:本地 AI 能解决什么问题? 本地 AI 的价值不在于“替代云端 AI”,而在于“覆盖云端 AI 无法覆盖的场景”。

场景二:企业级长任务自动化。Mano-P 支持数十步至上百步的复杂业务流程。例如,从 CRM 系统导出客户拜访记录、在 ERP 系统中录入数据、生成周报并发送邮件——整个流程可以在断网状态下自主完成,无需人工干预。相比传统 RPA 工具,Mano-P 不需要预设规则或 API 接口,界面改版也能自适应。

场景三:个人隐私助手。对于注重隐私的个人用户,Mano-P 可以本地处理邮件分类、日程管理、文件整理等任务。你的邮件内容、聊天记录、个人文件不会被发送到任何外部服务器。

六、怎么在 Mac 上安装Mano-P? Mano-P 为不同用户提供了三种使用形式,覆盖从普通用户到开发者的全谱系需求。

第二种是 mano-client Python SDK(开发中)。适合需要在 Python 项目中集成 GUI 自动化能力的开发者:

第三种是 mano-skill AI Agent 插件(已发布)。如果你使用 OpenClaw 或 Claude Code 等 AI Agent 平台,可以直接安装 skill:

七、常见问题

Q: Mano-P 是什么?

Mano-P是明略科技开源的端侧GUI-VLA智能体。Mano是西班牙语中“手”的意思,P有两重含义:Person(个体)和Party(组织)。它能像人一样通过纯视觉理解操作电脑界面,支持在Mac上完全本地运行。

Q: Mano-P与Claude Computer Use相比如何?

两者的核心区别在于架构:Claude Computer Use将屏幕截图上传到Anthropic的云端服务器进行分析和决策;Mano-P在你自己的Mac上完成所有推理,截图和操作数据不出设备。在性能上,Mano-P 1.0-72B在OSWorld上取得58.2%(专用模型全球第一),在WebRetriever Protocol I上取得41.7 NavEval,均超越同类云端方案。本地AI不等于弱AI。

Q: Mano-P可以离线运行吗?

可以。本地模式下,Mano-P的模型完全运行在你的Mac设备上,不需要网络连接。所有截图分析、任务规划和GUI操作都在本地完成。

Q: Mano-P需要什么硬件配置?

最低配置为Apple M4芯片 + 32GB内存的Mac mini或MacBook。4B量化模型的峰值内存占用仅4.3GB,不会影响日常使用。也支持通过USB 4.0或更高版本端口连接的算力棒进行部署。

Q: Mano-P如何安装?

通过 Homebrew 安装:`brew tap HanningWang/tap && brew install mano-cua`。

Q:我的数据安全吗?

架构级安全保障:本地模式下,Mano-P的所有推理在设备本地完成,屏幕截图不上传、不外传,支持完全离线运行。Apache 2.0 开源协议,代码可审计。

以客户为中心,集新模式与高质量服务为一体

以客户为中心,集新模式与高质量服务为一体 助力零售行业打造覆盖客户全生命周期的数值化运营体系

助力零售行业打造覆盖客户全生命周期的数值化运营体系 围绕家具行业消费者连接的全流程, 从引流获客,导购,设计赋能

围绕家具行业消费者连接的全流程, 从引流获客,导购,设计赋能 从品牌商家的核心诉求出发,重新定 义“人货物,构建以大数据驱动的….

从品牌商家的核心诉求出发,重新定 义“人货物,构建以大数据驱动的…. 帮助家电3C企业构建公域私域联动的 流量

帮助家电3C企业构建公域私域联动的 流量 母婴消费者数据全链路管理,发现消费者全链路路径路径决策点,沉淀母婴行业全链路消费数据

母婴消费者数据全链路管理,发现消费者全链路路径路径决策点,沉淀母婴行业全链路消费数据